![]()

Succesvol starten met sustainability

![]()

Succesvol starten met sustainability

Tegenwoordig hoor je iedereen praten over ‘generatieve AI’ in plaats van enkel AI. Dit komt doordat de traditionele AI zich richt op een specifieke taak en/of input, ook wel Artificial Narrow Intelligence (ANI) genoemd, denk aan Siri en Alexa. Deze AI-producten zijn getraind om spraak te herkennen en op basis hiervan te handelen, maar creëren niet iets nieuws. Dit is wel het geval met Generatieve AI. Zo kan ChatGPT op basis van jouw vraag nieuwe tekst of afbeeldingen creëren (1). Deze nieuwe ontwikkeling zorgt voor nieuwe mogelijkheden, maar draagt ook serieuze risico’s met zich mee als we geen rekening houden met de mogelijk negatieve impact van AI. In dit artikel leggen we uit hoe generatieve AI werkt, wat het verbruikt aan grondstoffen en wat de risico’s zijn van AI op de maatschappij.

Vroeger waren programmeurs genoodzaakt alle functies van een digitaal systeem uit te schrijven in code. Maar dankzij ontwikkelingen in de onderzoeksgebieden Machine Learning en Deep Learning is dit niet meer nodig. Programmeurs schrijven nu enkel algoritmes (wiskundige instructies) die duidelijk maken hoe het digitale systeem moet leren van de data die het krijgt. Hierbij wordt het systeem steeds beter, zonder verdere externe instructies. De programmeur moet het model alleen af en toe bijsturen voor betere resultaten. Het systeem is daardoor voor een groot deel zelflerend. Dit noemt men Machine Learning. Hiervoor is veel gestructureerde en gelabelde data nodig. Zo gebruikt Spotify Machine Learning om jou te voorzien van nieuwe suggesties. Dit is geen generatieve AI, maar Artificial Narrow Intelligence (ANI). Machine Learning maakt ANI en Deep Learning mogelijk.

Voor generatieve AI hebben we Deep Learning nodig. Dit gaat nog een paar stappen verder met het gebruik van kunstmatige neuronen naast Machine Learning. Deze neuronen kunnen op basis van data verbanden leggen door patronen uit de data te herkennen. Uit deze verbanden, die niet te herleiden zijn door de programmeurs, trekt het systeem een conclusie. Dat is het resultaat wat je te zien krijgt, zonder de redenering erachter.

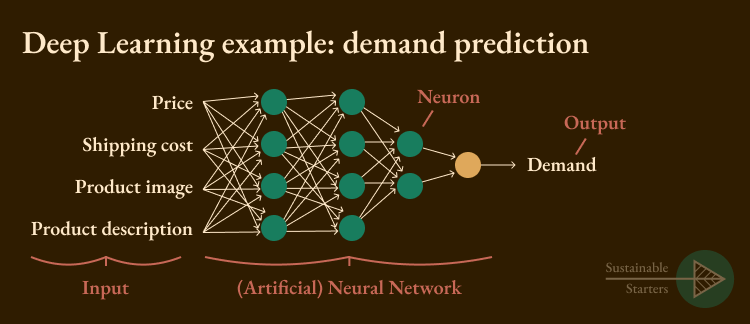

Hieronder een voorbeeld hoe Deep Learning in zijn werk gaat:

Je hebt bijvoorbeeld een webshop en je wilt weten wat de vraag gaat zijn naar een bepaald product, zodat je niet te veel of te weinig inkoopt. Je voedt het AI-model data van je webshop met informatie over de prijs, verzendkosten, afbeelding en omschrijving van je producten. Per product geeft het AI-model aan hoeveel vraag er naar is door achter de schermen verbanden in de data te leggen met kunstmatige neuronen. Deze verbanden zouden betaalbaarheid, verwachte kwaliteit en behoefte voor het product kunnen zijn. Dit laat het AI-model je niet zien, maar wel wat de verwachte vraag naar het product zal zijn (1).

Generatieve AI wordt door veel mensen als een soort wonderlijke computermagie gezien waarmee je allemaal interessante ideeën, content en oplossingen kan genereren uit het niets. Dit is uiteraard niet het geval. Zo is er veel bloed, zweet en tranen aan voorafgegaan bij het ontwikkelen van ChatGPT. Namelijk het volgende:

Bekijk hier de anatomie van het AI-systeem Echo van Amazon gemaakt door Kate Crawford en Vladan Joler: https://anatomyof.ai/

Generatieve AI lijkt al snel dé oplossing voor al onze problemen, maar welke (lange termijn) risico’s draagt het met zich mee naast het uitputten van onze grondstoffen?

Wij mensen zijn snel geneigd te denken dat computers slimmer zijn dan wij en geen fouten kunnen maken. Alleen is generatieve AI niet te vergelijken met bijvoorbeeld een superslimme rekenmachine. Generatieve AI trekt namelijk conclusies uit data en is dus afhankelijk van de kwaliteit van de data. Zoals je weet is veel data dat te vinden is op het internet niet correct of bevat veel haatdragende, discriminerende of stereotyperende inhoud. Misschien herinner je je nog de racistische Twitterbot Tay van Microsoft, een goed voorbeeld van hoe slechte data zorgt voor een slecht resultaat.

Daarnaast blijven antwoorden van AI gebaseerd op data, niet op ervaringen en gevoelens die mensen hebben. Het antwoord van AI zal daarom altijd een statische middelmatigheid zijn of het bootst gevoelens en ervaringen van mensen na. Oftewel, je kan worden misleid door AI. Als een AI-model het antwoord niet weet, bedenkt het een antwoord op basis van alle data die het heeft. Dit noemt men hallucineren. Zo blijkt uit onderzoek dat zelfs de beste AI-modellen 65% van de gevallen hallucineert, dus niet zeker is of het antwoord klopt (7). Een ander recent onderzoek wijst uit dat ChatGPT 76% van 200 citaten verkeerd geïdentificeerd had en gaf slechts in 5% van de gevallen toe dat het antwoord niet zeker was. Zie de afbeelding hieronder (8).

Je zou denken dat de antwoorden van AI-tools gecheckt worden door mensen als het zo foutgevoelig is. Helaas checkt maar 27% van de bedrijven alle AI-output voordat het gebruikt wordt en 30% checkt slechts 1 op de 5 antwoorden (9). Oftewel, veel bedrijven handelen al op basis van foute AI antwoorden. Dit heeft al tot meerdere grote fouten geleid, denk aan het toeslagenschandaal bij de belastingdienst of een van deze andere 32 fouten door AI. Dit komt waarschijnlijk ook omdat er geen duidelijke regelgeving is wie eindverantwoordelijk is voor de gemaakte fouten. Degene die het AI-model maakt, de AI zelf of het bedrijf of de persoon die het AI-model gebruikt? Zoals eerder uitgelegd, is de werking van AI niet transparant, zelfs niet voor de ontwikkelaar zelf. Toch wordt AI voor alles ingezet, ook voor militaire doeleinden, zoals het vinden van “terroristen” in Gaza.

Naast het maken van serieuze fouten pleegt AI ook plagiaat. Zo gebruiken veel AI-modellen het werk van vele schrijvers, kunstenaars, digitale ontwerpers, filmproducenten, zangers en acteurs en wordt dit gebruikt om “nieuwe” afbeeldingen, films, liedjes en teksten te creëren. Vaak wordt hiervoor geen toestemming gevraagd aan de makers. De grote techbedrijven komen hier tot nu toe vaak mee weg, al lijkt de New York Times hier verandering in te brengen.

Het is nu soms al lastig om te zien of een foto of video nep of echt is. Vaak klopt er een klein detail niet waardoor je kan herkennen dat het gemaakt is met AI: zoals handen met 6 vingers of een net iets te gladgestreken achtergrond. Hoe meer AI gebruikt en gecorrigeerd wordt, hoe echter de gegenereerde content eruitziet. De gevaren hiervan zijn dat je al snel dingen gaat geloven die niet waar zijn doordat mensen generatieve AI met verkeerde intenties gebruiken. Denk bijvoorbeeld aan: iemand die jouw identiteit steelt met foto’s en video’s van je sociale media, politieke propaganda die verspreid wordt zodat je op een bepaalde partij gaat stemmen en neppe voicemails van vrienden die geld nodig hebben in een noodsituatie.

Het ontwikkelen van AI-modellen kost aardig wat geld, hierdoor kunnen eigenlijk enkel grote techbedrijven dit bekostigen. Andere bedrijven kunnen wel gebruikmaken van deze AI-modellen, maar zijn daardoor dus afhankelijk van deze grote techbedrijven zoals Google, Amazon en Microsoft. Deze techbedrijven hebben al veel politieke invloed en dat zal hierdoor alleen maar groeien, waardoor ze uiteindelijk nog minder belasting hoeven te betalen (10). Dit zorgt ervoor dat het geld vooral bij de techbedrijven blijft en niet ten goede komt voor de gehele maatschappij.

Daarnaast zullen veel mensen, die al weinig geld verdienen, hun baan verliezen. Namelijk banen die makkelijk geautomatiseerd kunnen worden zoals fabrieksarbeiders en bezorgers (11). Het tegenargument is vaak: ze kunnen zich omscholen en ander werk gaan doen, maar vaak zijn deze arbeiders genoodzaakt dit soort baantjes te hebben omdat ze door hun taal of afkomst geen andere keuze hebben.

Meerdere onderzoeken (12, 13 & 14) bevestigen dat AI-technologie in ieder geval op de korte termijn voor inkomensongelijkheid zal zorgen. Op de lange termijn kan dit rechtgetrokken worden als we AI op zo’n manier inrichten dat het ongelijkheid tegengaat in plaats van dit te versterken door bepaalde groepen mensen negatief of juist positief te discrimineren. Denk bijvoorbeeld aan het selecteren van een geschikte kandidaat voor een baan als manager. Hierbij maken vrouwen minder kans, omdat AI geleerd heeft op basis van data dat de meeste managers man zijn.

Met het gebruik van AI moeten we extra voorzichtig zijn met het geven van onze biometrische gegevens zoals vingerafdrukken, gezichtsherkenning en irisscans. Deze biometrische gegevens worden vaak als wachtwoorden gebruikt, maar kunnen niet gewijzigd worden en zijn dus permanent. Zo worden er al veel foto’s op verschillende social media platforms gebruikt om AI-modellen te trainen, zonder dat hier duidelijk toestemming voor gevraagd wordt (15). Je denkt in eerste instantie dat dit niet veel uitmaakt, maar deze foto’s zouden uiteindelijk gebruikt kunnen worden door beveiligingscamera’s om surveillance gegevens te analyseren. Ook hierbij worden er soms mensen (vaak mensen van kleur) onterecht gearresteerd door AI-fouten (16).

AI zorgt er ook voor dat onze gegevens minder veilig zijn. Als je de data van je vingerafdruk bijvoorbeeld wordt blootgesteld door een (prompt)hacker, kunnen ze je voor altijd identificeren en je vingerafdruk gebruiken. Want AI wordt nu ook als tool ingezet door hackers, waardoor niet goed beveiligde databases nog kwetsbaarder zijn (17).

Bedrijven die al gebruikmaken van generatieve AI houden zich vooral bezig met de volgende risico’s (zie afbeelding hieronder, 9). Hierbij zie je dat de impact van AI op het klimaat en de maatschappij niet hoog op de agenda staat. In ons volgende artikel over AI bekijken we hoe we als ondernemers AI op een ethische en duurzame manier kunnen inzetten.

Bronnen